بولتن هوش مصنوعی

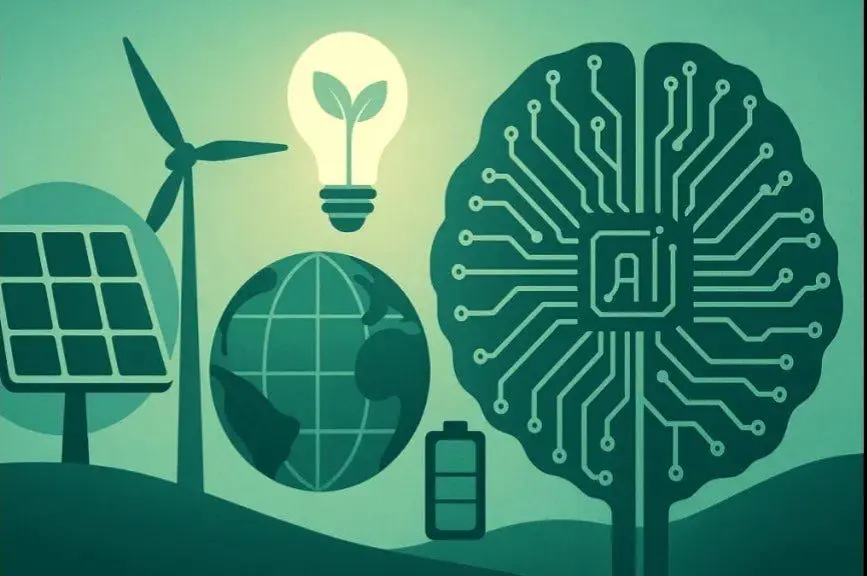

پشت پردهی پاسخهای هوشمند: سونامی مصرف انرژی در راه است

از چتجیپیتی تا DeepSeek: زنجیرهی تفکر ۹ صفحهای، مصرف انرژی را از مرز ۱۰۰ گیگاواتساعت عبور میدهد.

به گزارش هممیهن آنلاین، در بولتن هوش مصنوعی امروز، دنباله گزارش جذاب MIT درباره تأمین انرژی سامانههای هوش مصنوعی و عواقب آن را ارائه میکنیم و ادامه بحث از تأمین سوخت و آلایندگی در این حیطه را میبینید.

هوش مصنوعی همینجا است!

آنچه تاکنون مشاهده کردهایم این است که انرژی مورد نیاز برای پاسخ به یک درخواست میتواند نسبتا کم باشد، اما بسته به نوع درخواست و مدل مورد استفاده، تفاوتهای زیادی دارد. میزان انتشار کربن مرتبط با این مقدار مشخص از برق نیز به جایی که درخواست پردازش میشود و زمان آن بستگی خواهد داشت. اما در نهایت، این همه چه مفهومی خواهد داشت؟

در حال حاضر، برآورد میشود که چتجیپیتی پنجمین وبسایت پر بازدید در جهان است، درست پس از اینستاگرام و پیش از X. در دسامبر، OpenAI اعلام کرد که چتجیپیتی روزانه 1 میلیارد پیام دریافت میکند و پس از آن که شرکت در ماه مارس یک تولیدکننده تصویر جدید را راهاندازی کرد، اعلام کرد که مردم از آن برای تولید 78 میلیون تصویر در روز استفاده میکنند، از پرترههای به سبک استودیو گیبلی گرفته تا تصاویری از خودشان به شکل عروسکهای باربی.

با توجه به جهتگیریای که هوش مصنوعی در پیش دارد—شخصیسازی بیشتر، توانایی استدلال و حل مشکلات پیچیده به جای ما و حضور در همه جا—به احتمال زیاد اثر هوش مصنوعی ما در حال حاضر کوچکترین آن خواهد بود.

برای تخمین تاثیرات انرژی، میتوان از برخی محاسبات تقریبی استفاده کرد. در فوریه، شرکت تحقیقاتی Epoch AI تخمینی از میزان انرژی مصرفی برای یک درخواست چتجیپیتی منتشر کرد—تخمینی که همانطور که گفته شد، فرضیات زیادی دارد که نمیتوان آنها را تأیید کرد. با این حال، آنها حدود 0.3 واتساعت، یا 1,080 ژول، برای هر پیام محاسبه کردهاند. این مقدار بین تخمینهای ما برای مدلهای کوچک و بزرگ Meta Llama قرار میگیرد (و کارشناسانی که ما با آنها مشورت کردیم میگویند که اگر چیزی باشد، رقم واقعی احتمالاً بیشتر است، نه کمتر).

اگر یک میلیارد درخواست روزانه برای یک سال ادامه پیدا کند، این معادل بیش از 109 گیگاواتساعت برق خواهد بود، که برای تأمین انرژی 10,400 خانه در ایالات متحده برای یک سال کافی است. اگر تصاویر را نیز اضافه کنیم و فرض کنیم که تولید هر تصویر به اندازه مدلهای تصویر با کیفیت بالا ما انرژی میبرد، این به معنای 35 گیگاواتساعت اضافی است، که برای تأمین انرژی 3,300 خانه دیگر برای یک سال کافی است. این علاوه بر تقاضاهای انرژی محصولات دیگر OpenAI مانند تولیدکنندگان ویدئو و دیگر شرکتها و استارتاپهای هوش مصنوعی است.

اما مشکل اینجاست: این تخمینها آینده نزدیک استفاده از هوش مصنوعی را به درستی منعکس نمیکنند. در آن آینده، ما تنها به مدلهای هوش مصنوعی یک یا دو سوال نمیدهیم یا از آنها برای تولید یک عکس استفاده نمیکنیم. در عوض، آزمایشگاههای پیشرو در حال رقابت برای رسیدن به جهانی هستند که در آن «نمایندگان هوش مصنوعی» بدون نیاز به نظارت مداوم ما، وظایف را برای ما انجام میدهند. ما با مدلها به صورت صوتی صحبت خواهیم کرد، دو ساعت در روز با همصحبتهای هوش مصنوعی گپ خواهیم زد و دوربینهای تلفنهای خود را به محیط اطرافمان در حالت ویدیویی هدایت خواهیم کرد. ما وظایف پیچیدهای را به مدلهای «استدلالی» میدهیم که کارهایشان را به صورت منطقی انجام میدهند اما مشخص شده که برای حل مسائل ساده 43 برابر بیشتر انرژی نیاز دارند، یا مدلهای «تحقیقات عمیق» که ساعتها برای ما گزارش تهیه میکنند. ما مدلهای هوش مصنوعی خواهیم داشت که با دادهها و ترجیحات شخصیسازی شدهاند.

این آینده در گوشه و کنار است: گفته میشود OpenAI نمایندگان خود را به قیمت 20,000 دلار در ماه ارائه خواهد داد و از قابلیتهای استدلال در تمام مدلهای خود در آینده استفاده خواهد کرد، و DeepSeek با مدل خود که معمولاً 9 صفحه متن برای هر پاسخ تولید میکند، «زنجیره تفکر» را به جریان اصلی آورد. مدلهای هوش مصنوعی به همهچیز اضافه میشوند، از خطوط تلفن خدمات مشتری گرفته تا دفاتر پزشکان، و به سرعت سهم هوش مصنوعی از مصرف انرژی ملی را افزایش میدهند.

هر پژوهشگری که با او صحبت کردیم گفت که نمیتوانیم تقاضای انرژی این آینده را فقط با استنباط از انرژی مصرفی در درخواستهای هوش مصنوعی امروز درک کنیم. و در واقع، اقدامات شرکتهای پیشرو در هوش مصنوعی برای راهاندازی نیروگاههای هستهای و ایجاد مراکز داده با مقیاس بیسابقه نشان میدهد که چشمانداز آنها برای آینده انرژی بسیار بیشتری از حتی تعداد زیادی از این درخواستهای فردی مصرف خواهد کرد.